AI做视频效果拉胯?别只怪工具!这两个核心原因才是关键

AI做视频效果拉胯?别只怪工具!这两个核心原因才是关键

有没有发现,明明跟风用了AI视频工具,做出来的成品却总是差强人意?

画面卡顿、人物手指变形、镜头衔接生硬,要么就是和预期差太远,费了半天劲,还不如人工剪辑效率高。

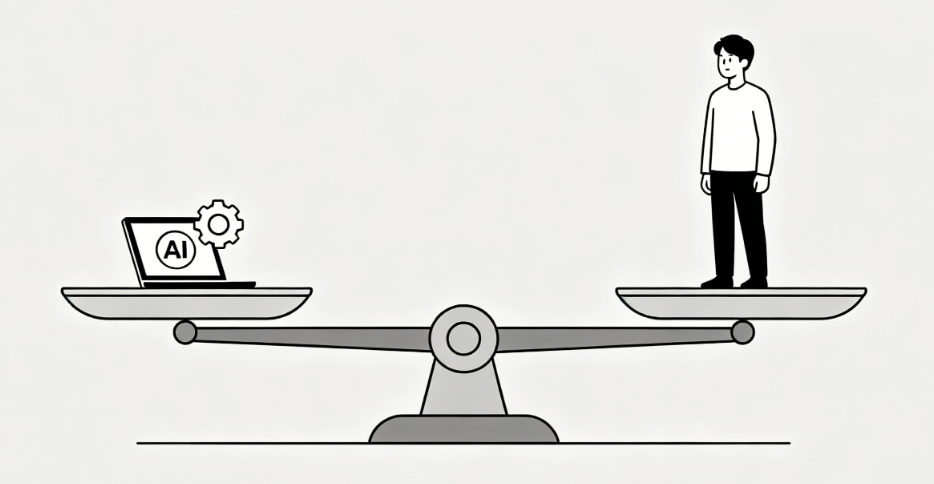

很多人吐槽“AI视频就是智商税”,但其实,AI做视频效果不佳,从来不是单一原因造成的——工具本身的局限性,和使用者对AI的认知、使用方法不足,两者各占一半,共同拉低了成品效果。

今天就把这两个核心原因拆解开,帮你搞懂问题出在哪,避开误区、少走弯路

一、AI工具本身的核心局限性:先天短板,难靠个人弥补

首先要明确一点:目前没有任何一款AI视频工具是“完美”的,它们的先天缺陷,是我们无法靠单纯操作弥补的,也是效果差的基础原因。

1. 生成逻辑有“先天缺陷”,不懂“视频叙事”

AI生成视频,本质是靠海量数据训练和算法拟合,它不懂镜头语言、不懂叙事逻辑,更不会表达情感。就像一个只会模仿的机器人,只会照搬数据里的画面,却不知道“为什么这么拍”。

所以经常会出现:画面衔接生硬、人物动作卡顿、物体变形(比如手指多一根少一根)、细节失真(背景穿模、光影错乱),看似是小问题,却直接拉低整体观感。

2. 可控性太差,难还原预期效果

很多人觉得“输入提示词,就能生成想要的视频”,但实际操作中会发现,即便把提示词写得再详细,也很难100%还原预期

尤其是对镜头运镜、画面构图、角色表情的精细化控制,AI的能力非常薄弱。遇到多人互动、动态特效、写实场景等复杂需求,还原度会大幅下降,甚至出现离谱的错误。

3. 技术分层明显,普通用户难用出好效果

AI视频工具的“门槛”,藏在技术和成本里。免费或入门级工具,受限于模型算力和训练数据,生成分辨率、帧率、视频时长都有严格限制,效果自然一般;

而专业级AI工具,虽然能生成更高质量的视频,但要么需要专业技术,要么收费昂贵,普通用户根本触及不到,相当于“有好工具,却用不上”。

4. 原创性不足,还藏着版权隐患

由于多数AI模型的训练数据同质化严重,生成的视频内容很容易缺乏新意,甚至出现“撞脸”相似画面的情况;更麻烦的是,部分工具的素材版权不清晰,即便做出了满意的效果,也可能面临版权纠纷,根本不敢商用

二、使用者的认知与能力不足:人为误区,可快速优化

如果说工具的局限性是“先天不足”,那使用者的认知和使用能力,就是“后天拖后腿”——这也是多数人做不好AI视频的主要原因,却也是最容易快速改善的部分。

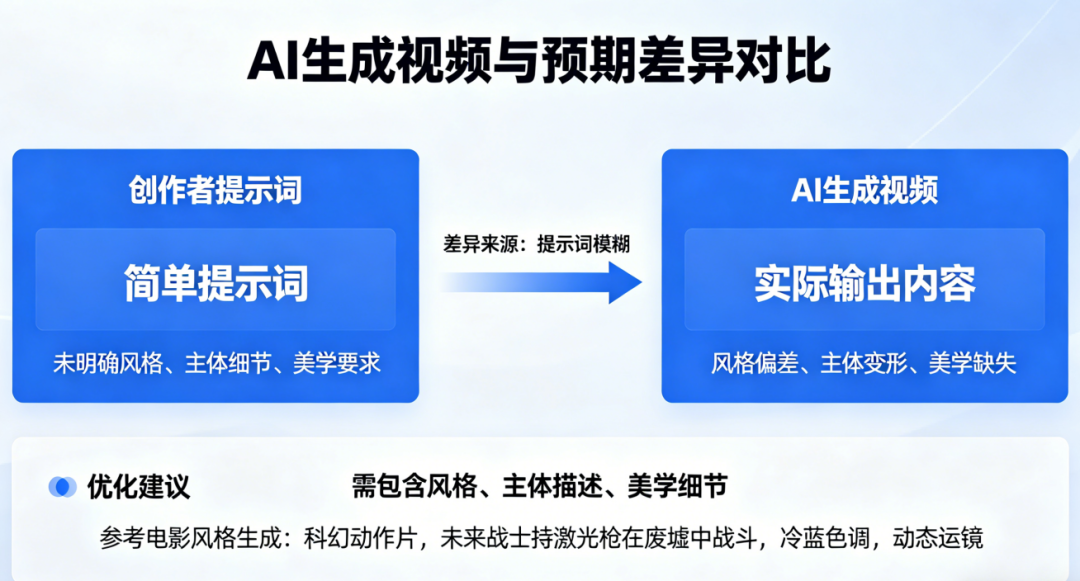

1. 提示词太“敷衍”,AI抓不住核心需求

提示词是AI生成视频的“指令”,但很多人写提示词,只说“做一个美食视频”“做一个剧情短片”,没有任何细节描述。

AI根本不知道你要什么镜头(近景/远景)、什么运镜(推镜/拉镜)、什么色调(暖调/冷调)、什么背景音乐,自然无法生成符合预期的内容。精准、结构化的提示词,才是AI出好效果的前提。

2. 对AI预期过高,把辅助工具当“全能神器”

很多人跟风用AI,是误以为它能“一键生成爆款视频”,能替代人工的策划、脚本、剪辑工作。

但实际上,AI只是一个辅助工具,它能帮你快速生成基础画面,却无法替代人的创意和审美。缺乏前期的脚本设计,不做后期的人工优化,哪怕AI生成的画面再完整,也很难成为优质视频。

3. 浪费工具功能,只依赖“一键生成”

多数AI视频工具,都自带分镜编辑、画面修复、风格微调、素材替换等实用功能,这些功能正是弥补AI瑕疵的关键。

但很多使用者,全程只依赖“一键生成”,生成后不做任何优化,任由AI的小瑕疵(比如画面模糊、衔接生硬)保留,成品效果自然差强人意。

4. 缺乏视频创作基础,不懂“怎么优化”

即便AI生成了不错的基础画面,很多人也不知道怎么优化——不懂镜头衔接逻辑、不会调整叙事节奏、不会搭配配乐和字幕,哪怕是简单的画面拼接,也做得杂乱无章

说到底,AI是工具,最终的成品效果,还是取决于使用者的视频创作基础

最后想说:

AI做视频,从来不是“一键躺平”的捷径,而是“人工+AI”的高效配合。

我们既要接受AI工具的局限性,不盲目高估它的能力;也要提升自己的使用技巧,用精准的提示词、合理的后期优化,弥补工具的不足。

与其吐槽AI不好用,不如先搞懂问题出在哪,针对性调整——毕竟,能把AI用好用活的人,才能真正节省时间、提升效率,在视频创作的赛道上少走弯路。

文章来源:TK大咖社